11月1日,“ChatGPT 可能已经有了意识”的话题登上了热搜话题榜。这一言论来自OpenAI首席科学家Ilya Sutskeve近期的表态,他认为,ChatGPT 背后的神经网络已经产生了意识,未来超级人工智能(AI)将会成为一种潜在风险。

更早之前,10月30日,美国总统拜登签署行政令,将对AI研发和应用制定全面的监管标准,这也是白宫首次发布针对AI的行政令。11月1日,首届全球人工智能安全峰会在英国布莱奇利园召开,中国、美国、英国、欧盟等多方代表签署了一项具有里程碑意义的《布莱切利宣言》,警告了最先进的前沿AI系统所带来的危险。

随着监管层面的加强,业内关于AI风险的大讨论被再次推向高潮。在社交媒体上,许多业内专家对AI构成的生存威胁发出警告,认为开源AI可能会被不良行为者操纵,(例如)更容易制造化学武器,而另一方面,反驳观点则认为这种危言耸听只是为了帮助将控制权集中在少数保护主义公司手中。

辩论不断升级,OpenAI首席执行官Sam Altman最近在剑桥参加活动时,甚至遭到了激进分子的强烈抵制。

面对如此激烈的争辩,开源AI到底危险吗?AI监管和开放,到底如何平衡?

“毁灭派”大战“开源派”

有关AI风险和监管的讨论在本周又一次被推向高潮。

OpenAI首席科学家Ilya Sutskeve近期接受《麻省理工科技评论》采访时认为,ChatGPT 背后的神经网络已经产生了意识,未来超级AI将会成为一种潜在风险。此外,拜登首次签署AI行政令,以及首届全球人工智能安全峰会签署《布莱切利宣言》,也预示着AI监管正在逐步收紧。

根据白宫最近新颁布的AI法规规定,对美国国家安全、经济、公共卫生或安全构成风险的AI系统开发商在向公众发布前,需要与美国政府分享安全测试结果,甚至还细致到规定了需要受到监管的AI模型参数。

此举立刻引发了AI业界大佬的论战,主张AI发展应该更加开放的“开源派”认为这会让算法效率的提高陷入困境,而认为AI可能对人类造成巨大风险的“毁灭派”则对此表示认同。

“开源派”以Meta首席AI科学家Yann LeCun和斯坦福大学计算机科学系和电气工程系的副教授Andrew Ng为代表,他们认为, AI强监管所带来的巨头垄断是从业者和政策制定者该真正关心的问题。

“毁灭派”以“AI教父”Geoffrey Hinton、蒙特利尔大学计算机科学教授Yoshua Bengio、纽约大学教授Gary Marcus为代表。Hinton在X平台上称,“我离开谷歌,就是为了自由地谈论(AI带来的)生存威胁。”

对此,Andrew Ng反击道,如果颁布“毁灭派”所希望的监管规定,将阻碍开源开发,并大大减慢创新速度。

Yann LeCun也认为,“毁灭派”正无意中帮助那些想通过禁止开放研究、开放源代码以及开放模型来保护自己业务的人,而这将不可避免地导致不良后果。

两个派系的辩论不断升级,继今年3月马斯克带头签署千人联名信,紧急呼吁 AI 实验室立即暂停研究后,两封新的联名信又出现了。

“毁灭派”牵头签署了一封联名信,呼吁针对人工智能制定一项国际性的条约,从而应对其潜在的灾难性风险。信中提到,“有半数AI研究人员估计,AI可能导致人类灭绝,或人类潜力受到类似灾难性限制的可能性超过10%”。截至发稿,该联名信已有322人签署。

图片来源:AITreaty官网

“开源派”则签署了一份呼吁AI研发更加开放的联名信,截至发稿,377名专家都签下了名字。

图片来源:mozilla官网

辩论升级,开源大模型到底危险吗?

值得注意的是,关于AI发展应该坚持开放还是得到更多严监管的辩论不仅在业界大佬层面,就连民众也开始纷纷站队。

在X平台上,“毁灭派”发起了“BelieveHinton”的话题,并举着标示牌走上了大街。

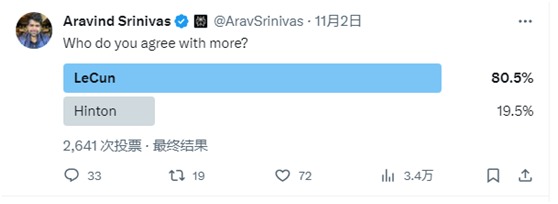

还有人发起了关于两个派系的投票。

图片来源:X

随着全球讨论持续升级,就连OpenAI的首席执行官Sam Altman最近在剑桥参加活动时,也遭到了激进分子的强烈抵制,在大礼堂里当面被砸场子。Sam Altman后来在演讲中表示,即便未来AI模型足够强大,但也需要巨大的算力才能运行。如果提高了算力门槛,能够降低蓄意犯罪风险,也能提高问责性。

面对如此激烈的争辩,一个问题是,开源AI到底危险吗?

10月20日,来自麻省理工学院和剑桥大学的专家们发表了一篇论文,他们通过实验研究了持续模型权重的扩散是否会帮助恶意者利用更强大的未来模型来造成大规模伤害,结果发现,开源大模型的确可能存在风险。

研究人员安排了一场黑客马拉松,17名参与者扮演生物恐怖分子,试图成功获得1918年导致大流行的流感病毒样本。参与者使用两个版本的开源模型,一个是具有内置保护措施的版本,一个是删除了保护措施的版本Spicy。

结果显示,Spicy模型提供了几乎所有需要的关键信息来获取病毒。释放未来能力更强的基础模型的权重,无论有多可靠的保护措施,都可能将引发风险。

站在对立面,Andrew NG认为,“当讨论这些论点的现实性时,我发现它们模糊且不具体,令人沮丧,因为他们归结为‘这可能会发生’”。

纽约大学教授Julian Togelius在一篇文章中讨论了以AI安全的名义监管AI发展到底意味着什么。

他的观点是,“构成最近的生成式AI热潮的神经网络实际上是几年前发明的,符号规划、强化学习和本体论都曾经是‘未来’。科技发展很快,我们不可能知道哪种特定的技术将带来下一个进步。而监管底层技术,对科技进步来说是一种深渊。”

编辑/樊宏伟