近期,一款名为ZAO的人工智能换脸APP在国内推出。用户只需上传一张正面照,就可以一键操作,把一些影视剧片段中演员的脸换成自己的,立刻生成视频,还可通过社交媒体传播,仿佛瞬间圆了明星梦。

这一款换脸APP很快就成了爆款,颇受欢迎,但也很快引起有关部门的注意,就在上周,工信部就网络数据安全问题约谈了相关公司。

与此同时,“换脸” 软件所依托的的一项AI技术,也引起了人们的关注,它被称为:DeepFake, 深度伪造。

外国媒体报道:我们不能相信网上的所有东西,没错,深度伪造,深度伪造,深度伪造!是的,这到底是什么?深度伪造技术是利用人工智能合成以假乱真的视频,这是一种高科技手段,可以把某些话塞进某人嘴里。

Deepfake(深度伪造),“Deep learning”(深度学习)和“Fake”(伪造)结合而成的新单词。

简单来说,这是一种可以实时伪造面部表情,并将其渲染成2D合成视频的人工智能技术。

早在一年多前, 2017年12月,一个名为“DeepFakes”的用户在Reddit网站发布“假视频”,将成人色情电影中演员的脸替换成了斯嘉丽·约翰逊等知名女演员的脸,画面以假乱真。这为人工智能换脸技术吸引来了一大波流量,“DeepFake”深度伪造,也逐渐成为这一技术的代称,同名算法也在Github开源,这是一个面向开源及私有软件项目的托管平台。

网络视频打假专家沃德尔博士:你好,今天我要和你讨论一项影响名人的新技术。(记得)奥巴马说特朗普是笨蛋,或者卡戴珊的说唱“因为我总是半裸吗”?深度伪造!深度伪造!深度伪造!这也是深度伪造,我也不是阿黛尔,我是(打击)网络伪造的专家。深度伪造用来形容人工智能技术合成的视频或音频文件。它起初就是一种非常基本的面部更换,现在还成了电影特技。有了这样的爆款技术,天啊,我们不能相信任何东西了。没错,深度伪造就是可怕的反乌托邦。它们只会变得更容易,制作成本也更低廉。

李浩是美国南加州大学的助理教授,“针幕动画”公司的联合创始人,这家公司推出的软件可以让用户在玩虚拟现实游戏和购物时,即时定制自己的三维虚拟化身。

“针幕动画”联合创始人李浩:现在我制作了一个你的化身。

美国公共广播公司记者奥布莱恩:一个和蔼整洁的奥布莱恩。

这种戏法可以用在任何人身上,当然也包括政界要人。

美国公共广播公司记者奥布莱恩:现在我成了我们的总统(特朗普),日本首相安倍晋三。

“针幕动画”联合创始人李浩:当然,这个技术可以用来做一些真的很坏的事情。但主要目的绝不是如此,它被用于娱乐,一个有趣的工具,用于时尚、生活方式各方面,带给我们更多体验。

但随着技术的发展,这样的合成图像或视频,真实度越来越强,欺骗性也越来越强。对此,研发者也不无担忧。

“针幕动画”联合创始人李浩:我们都假设会有一个临界点,届时将无法区分真假。我的意思是,从视觉效果上说,我觉得你已经可以做到非常接近了,只是取决于你花多少努力在上面。但就任何人都可以创建的内容而言,我认为已经非常接近这个临界点了。

2018年1月,一个名为FakeApp的软件上线,宣称可以实现“一键换脸”。可生成的视频内容包括恶搞美国总统特朗普,或是将自己的脸贴到好莱坞明星身上。

虽然有的社交新闻站点比如Reddit网站,已明令禁止在自己的平台传播换脸视频和图片,但仍有超过9万名用户在Reddit上传播这类视频。

计算机科学专家法里德:我担心这项技术被武器化,还担心它如何影响我们整个社会。

深度伪造不仅可以换脸,还可伪造声音。

据《华尔街日报》报道,今年3月,有犯罪分子利用“深度伪造”技术,电脑合成某公司CEO的声音,成功诈骗22万欧元。

电脑合成声音真的这么难以识破吗?

2018年,三名蒙特利尔大学的博士联合创办了一家名为“琴鸟”(Lyrebird)的公司。该公司开发出了一种“语音合成”技术,只要对目标人物的声音进行1分钟以上的录音,把录音丢给“琴鸟”处理,就能得到一个特别的密钥,利用这个密钥可以用目标人物的声音,生成任何想说的话。

“琴鸟”创始人:你需要录自己几分钟的声音。

彭博社记者 万斯:上千个字母在业余作家的屏幕上跳动,当你开始像这样吃东西时,就会有问题,你们最好退出政治圈,别干了。我不知道它怎么工作的,现在创建我的数字声音。创建你的数字声音至少需要一分钟,一分钟,我的天啊。

语音录制完后,“琴鸟”会自动运转合成出你的数字声音。

这时,只需要向电脑输入想说的话,就可以用新合成的你的声音说出来。

记者万斯的数字合成声音:人工智能技术似乎发展非常快,我们该感到害怕吗。

彭博社记者万斯:我的确听到了,真的很有意思。我只是随便挑了,我从没说过的话。

而且,“琴鸟”还能在合成声音中加入“感情”元素,让声音听上去更逼真。

彭博社记者万斯:现在为了实验一下我的电脑合成音,我要给我亲爱的妈妈打个电话,看看她是否能听出来。嗨,妈妈,你们今天什么安排。

万斯的母亲:今天一早家里没电了,我们正在房子里溜达。

万斯:我刚刚下班,等着接儿子回家。

万斯的母亲:好的。

万斯:我觉得我可能感染了病毒。

万斯的母亲:那你感觉不舒服,是吗?

万斯:哈哈,我刚才是和你捣乱,你刚才在和电脑说话。

万斯的母亲:我感觉在和你说话,真是奇妙。

万斯:你觉得吓人还是觉得不错。

万斯的母亲:如果涉及到非常重要的事情,真的挺吓人的。不过现在是你了,对吗?

万斯:我不知道。

万斯的母亲:听上去是你。

万斯:是吗?

万斯的母亲:是,是,听上去就是你。

彭博社记者万斯:很明显,有些人被这项技术吓坏了。因为我们已经让现实真相变得模糊不清。

“琴鸟”创始人:当然,的确存在有人利用这项技术做坏事的风险。但是,科技不可能停止发展,所以我们决定选择符合道德的做法,将技术展示给人们,让人们知道这项技术的可行性,让他们提高警惕。

网络安全公司Pindrop在2018年五月对美英德法四国共500家企业展开网上调查,结果显示,从2013年到2017年,语音欺诈案件的数量增加了350%,每638个欺诈电话中就有1个是人工合成声音。

瑞士苏黎世大学研究员乌德里什:长久以来,人类的声音是(造假者)最大的挑战,因为每种声音都极其复杂且独一无二,它们几乎不可能被伪造。但在最近几年,(科技)取得了巨大进步,视频素材和伪造声音的结合造成了巨大的威胁。

的确,有了成熟的声音造假技术,再配上伪造图像,做出一条以假乱真、别有用心的视频真的不难了。

“深度伪造”假视频:特朗普总统是个彻底的笨蛋,你看我永远不会说这些话,至少在公共演讲中(不会),但其他人会说,比如乔丹·皮尔。这是一个危险的时代,以后我们要对我们所信任的互联网更加警惕。在这个时代我们需要可信的新闻来源,听起来很简单,但我们该如何发展,信息时代将决定我们是生存,还是成为某种糟糕的反乌托邦。谢谢。

这段视频看上去是美国前总统奥巴马在发表演讲,实际上却是喜剧演员和电影制作人皮尔的表演,声音和画面都是通过软件合成的。

计算机科学专家法里德:人工智能系统合成了奥巴马的嘴,使其与音频流保持一致,让视频看起来像是奥巴马总统在说他之前从未说过的话。这叫作唇同步深度伪造。

技术本无善恶,深度伪造可以被运用于趣味视频、游戏以及广告合作中,但恶意运用也会带来严重后果。它可能会摧毁我们对现实的认知,使人们不敢再相信视频、录像。

美国卡内基国际和平基金会也警告称,深度伪造正在带来破坏性的影响,也会对反恐和国家安全造成危害。

计算机科学专家法里德:噩梦般的情况是,出来一段特朗普总统的视频,他在视频里说,我对朝鲜发射了核武器。有人黑进了他的推特账号,这条消息被疯狂传播,短短30秒,全球核战爆发。我觉得这可能吗?不,但并非完全不可能,而且会把你吓得半死,对吗?但这并非不可能的事实,真的令人担忧。

从“深度学习”到“深度伪造”,照片、声音、视频都可轻松造假,而识别深度伪造则要比制作深度伪造难得多。

当“眼见未必为实,耳听未必为真”,我们又该怎么办?

扎克伯格“深度伪造”假视频:这都要归咎于Spectre漏洞,它告诉我谁掌控了数据,谁就掌控了未来。

今年6月,图片分享网站Instagram出现这样一段视频。脸书公司创始人扎克伯格就大数据的威力发表演讲。

但很快,扎克伯格就辟谣说,自己从未说过这些话。事实上,这是以色列一家科技公司利用深度伪造技术合成而来的。

略显尴尬的是,脸书曾宣称,该公司不会删除假新闻,但会减少其在网站上的影响力,并显示来自事实核查人员的信息。

而Instagram总裁莫斯里也在接受采访时表示,目前业界还没有大规模的数据或标准对这些假视频进行检测。

Instagram总裁莫斯里:目前,我们还没有应对深度伪造的政策,我们正试着评估是否愿意这么做。如果要做,又该如何定义深度伪造。我觉得(此类事件)并不好。

主持人盖尔·金:你可以限制这种技术,你有影响力。

莫斯里:实际上,我想的不仅是把它撤下来,我认为问题在于,我们如何以有原则的方式做到这一点。

对此,《财富》杂志呼吁说,现在已经到了科技公司、学术界和政府共同努力寻找解决方案的时候了。

6月13号,美国众议院情报委员会召开关于人工智能深度伪造的听证会,公开谈论了深度伪造技术给国家、社会和个人带来的风险,以及该采取的防范和应对措施。

目前,世界多国也都开始进行立法,强化对人脸信息收集和识别技术应用场景的约束。但所有努力都离不开社交媒体平台的配合。

计算机科学专家法里德:但大多数情况下,社交媒体平台对如何处理这类非法内容、有害内容、不实信息、假新闻、选举篡改、非自愿的色情等内容都显得漫不经心,因为这些内容吸引眼球,对生意有好处。

近日,脸书、微软等科技公司和众多学术机构联合发起一场“揪出深度伪造影像挑战赛”,希望改善现有工具,加强对深度伪造图片、声音和视频的检测能力。

9月5号,脸书宣布将为此投入1000万美元。

美国加州大学伯克利分校的研究人员也在研究如何应对深度伪造。

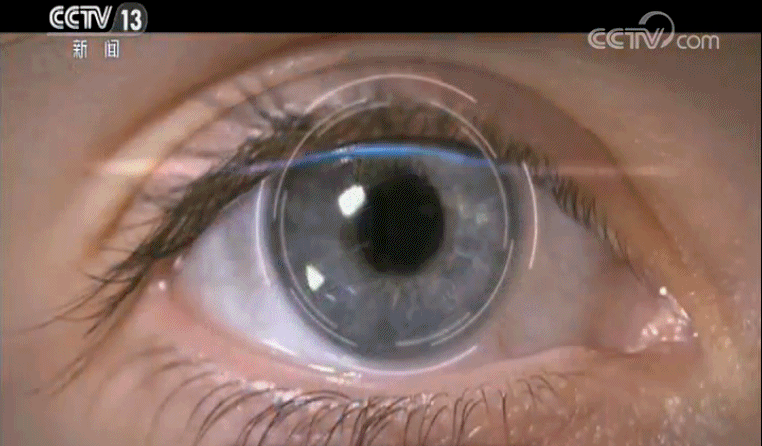

计算机科学专家法里德:我们应对这一问题的方式是,建立了软生物识别模型。这些生物特征指的是像指纹、虹膜、面部。它没有那么独特,但其目的是捕捉微妙的面部表情、头部移动,这些每个个体独有的,但在假视频制作时被打乱了的特征。

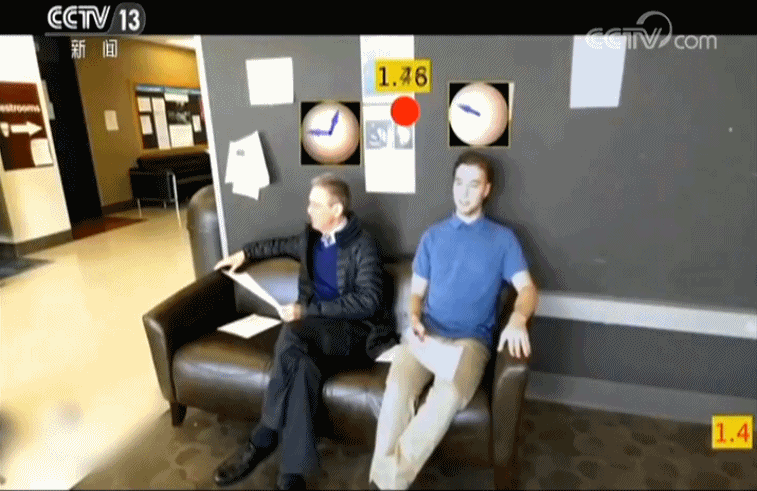

计算机科学专家 法里德:首先我们会测量各种头部移动和面部表情,你可以在这个视频里,看到我们正在捕捉蓝色盒子,正在捕捉他的头部在三维空间里如何转动。红点是在定位他的面部表情,实际上我们可以看到他何时会抬起眉毛,何时会张大嘴巴。当然,他眼睛里的绿色激光会告诉我们他在看哪里。整个视频中的每一帧画面,我们都会对他的面部表情、面部动作、头部动作做一些测量,之后我们用这些建立软生物识别模型。

计算机科学专家法里德感叹称,制作假视频的人越来越多,造假技术发展非常迅速,而相比之下,打假队伍的力量显得落后而薄弱。

美国五角大楼有一个研究团队,又称美国国防高级研究计划局,也在一直研究如何抵抗“深度伪造”的威胁。

计算机科学家图雷克:这让我们对图片和录像都不信任了。

而检测伪造视频的软件,可以描述嘴唇运动,将其与视频中的声音进行比对。

计算机科学家图雷克:当看到这些红点时,意味着说话者的声音实际上与其嘴唇运动不一致。

再来看这段视频,看上去这两人是坐在一起的,但通过测定他们脸上的光照角度,可以判定这是一个合成的视频。

计算机科学家图雷克:它预估了一个人脸3D模型跟这个模型一起,软件还估计了面部反射特征和光照角度。这里,我们主要使用了光照角度来看那些(特征)是否一致。

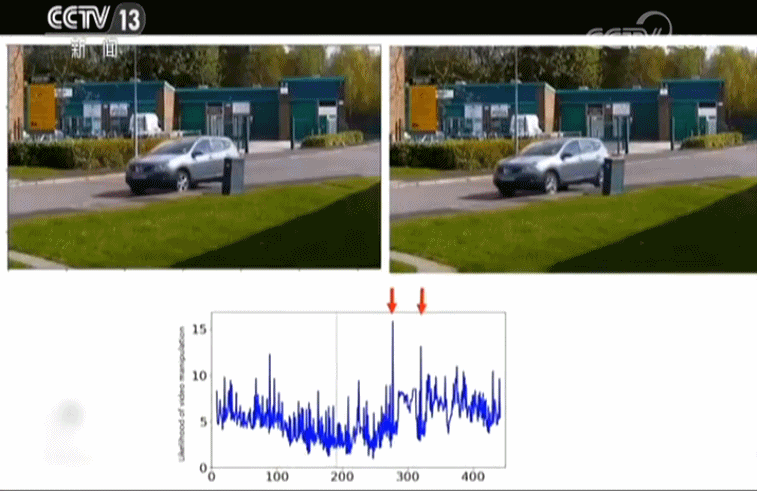

这是监控录像中的一段画面,检测软件试图预测物体的移动方向。

计算机科学家 图雷克:它检测到了物体运动的不连续性,这给我们发出了信号来仔细查看图片或视频,(推断出)也许画面就是从这里被清除的。

检测发现这段视频被动过手脚,另一辆车被从画面中剪切掉了。

计算机科学家图雷克:这是一个猫和老鼠的游戏,拆穿假图片或视频的层面越多,给造假者形成的压力也就越大。

两年前,美国发布《人工智能与国家安全》报告,明确将人工智能伪造技术列为威胁国家安全的重点技术。

作为人工智能发展大国,中国也已经在加强政策和技术方面的监管,应对人工智能新技术可能带来的安全风险。

毕竟,当声音、指纹、人脸等重要的生物识别信息都开始出现“高仿”时,风险和隐患也将越来越多。

来源/央视新闻

编辑/樊宏伟