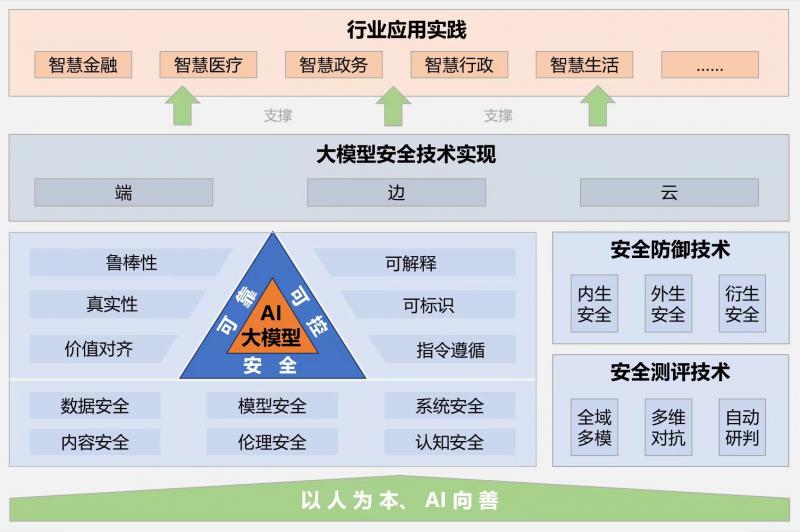

7月5日下午,清华大学、中关村实验室、蚂蚁集团等机构联合撰写的《大模型安全实践(2024)》白皮书在2024世界人工智能大会上正式发布。这也是国内首份“大模型安全实践”研究报告,为行业打造高价值参考体系。白皮书首次系统化提出安全实践总体框架,从安全性、可靠性、可控性等维度给到了技术实施方案,同时提供了金融、医疗、政务等领域的大模型安全应用案例,以及“五维一体”协同共治的治理框架。

作为报告核心,大模型安全技术体系里,安全性意味着确保模型在所有阶段都受到保护,涉及数据安全、模型安全、系统安全、内容安全、认知安全和伦理安全等;可靠性要求大模型在各种情境下都能持续提供准确、一致、真实的结果;可控性关乎模型在提供结果和决策时能否让人类了解和介入,可根据人类需要进行调适和操作。通过这三个维度,可提升大模型的鲁棒性、可解释性、公平性、真实性、价值对齐、隐私保护等方向的能力。

白皮书指出安全评测技术和安全防御技术也是保障大模型安全的有效手段,但目前大模型的安全评测绝大多数是针对内容类场景,随着大模型技术快速发展和广泛应用,对Agent这类复杂大模型应用架构和未来通用AGI的评估是当下面临的挑战。制定标准建立面向未来的大模型可信测评体系将会变得越来越重要,这需要政府、高校等机构,联合有相关经验的企业共同合作。

白皮书以蚂蚁集团自研的大模型安全一体化解决方案“蚁天鉴”为例,介绍了国内机构和企业在探索大模型安全应用的优秀实践。

蚁天鉴是一款兼具大模型安全测评和防御的产品,目前已开放给20余家外部机构和企业,在金融、政务、医疗等重要领域得到采用,为行业大模型数据、训练、部署、应用等环节提供安全保障。

例如,在金融场景,蚂蚁AI金融助理“支小宝”,通过“蚁天鉴”从大模型训练与推理风险管控、大模型风险点全方位评测、大模型用户交互风险管控三个方面保障大模型应用安全;针对金融业务,通过内嵌一致性检验和金融价值对齐,确保数据的准确性和金融逻辑的严格性。在医疗场景,上海市第一人民医院通过引入“蚁天鉴”平台,在其首创安全前置护栏技术保障下,可精准杜绝医院最关注的风险的出现,保障医疗大模型生成的内容更符合医疗垂类的安全和专业,有效应对大模型应用中的信息安全与隐私保护、双向内容风险防控等问题。在政务领域,“赣服通”政务AI助理在端侧实施的安全措施具有借鉴意义,其结合“蚁天鉴”通过千万政务预料训练来实现精准意图识别、智能追问反问和高频事项即问即办等功能;针对政务行业大模型应用中生成不可控、安全覆盖面广、内容对抗强、时效要求高等挑战,构建安全护栏和安全防御两大核心能力,覆盖数百项大模型内容生成风险,可应对单次50万量级的饱和攻击。

清华大学长聘副教授、博士生导师李琦指出,大模型安全应用是一个新兴领域,研究和应用尚处于起步阶段。不少企业是在原有的传统数据安全、信息安全、系统安全等经验基础上,进行能力迁移,应用于大模型安全。随着新的大模型安全实践的不断深入,技术也会持续升级,为大模型安全构建实践范式,打造高价值参考体系。

文/北京青年报记者 温婧

编辑/樊宏伟