在9月底的开发者大会上,Meta刚刚炸场,发布了十年磨一剑的产品——全息AR眼镜Orion,号称“至今为止最先进的眼镜”,拉动股价至历史新高。北京时间10月4日晚,Meta再次投下重磅炸弹,发布类Sora的视频生成模型Movie Gen,官方称这是“迄今为止最先进的媒体基础模型”。

截至10月5日收盘,Meta涨2.26%,股价达到595.94美元的历史新高。自今年年初以来,Meta股价已上涨超过70%,目前最新总市值来到了1.51万亿美元。随着Meta股价的持续攀升,其CEO马克·扎克伯格(Mark Zuckerberg)首次超越亚马逊创始人贝索斯,成为全球第二大富豪,仅次于马斯克。

在官方博客中,Meta表示,全新发布的 Meta Movie Gen是先进的沉浸式叙事模型系列,拥有视频生成、个性化视频生成、精确视频编辑和音频生成四大功能。从Meta演示的视频来看,其在画面美感、细节、人物动作流畅度、物理规律等方面都做到了不错的效果。

在具体功能方面,用户可以通过上传图片,利用 Meta Movie Gen 生成既个性化但又保持人物特征和动作的视频。用户也可以通过提供视频文件或文本内容,让 Meta Movie Gen 生成相对应的音频。Movie Gen支持生成 1080P、16 秒、每秒 16 帧的高清长视频,以及能够生成最长 45 秒的高质量音频。

不过,如同Sora一样,Movie Gen也是“期货”产品,目前尚未对外开放,也没有明确的时间表。官方称正在积极地与娱乐行业的专业人士和创作者进行沟通和合作,预计将在明年某个时候将其整合到 Meta 自己的产品和服务中。

据外媒,Meta 副总裁 Connor Hayes 透露了延迟推出的重要原因,他表示Meta Movie Gen 当前使用文本提示词生成一个视频往往需要等待数十分钟,极大影响了用户的体验。Meta 希望进一步提高视频生成的效率,以及实现尽快在移动端上推出该视频服务,以便能更好地满足消费者的需求。

Meta称Movie Gen是在授权和公开数据集的组合上训练。对于背后的技术细节,Meta AI 研究团队也在社交媒体上公开了一份长达 92 页的论文。据介绍,Meta 的 AI 研究团队主要使用两个基础模型来实现这些广泛的功能,包括Movie Gen Video 以及 Movie Gen Audio 模型。

Movie Gen Video 是一个 30B 参数的基础模型,用于文本到视频的生成,能够生成高质量的高清视频,最长可达 16 秒。而 Movie Gen Audio 模型则是一个 13B 参数的模型,用于视频和文本到音频的生成,能够生成长达 45 秒的高质量和高保真的音频,包括声音效果和音乐,并与视频同步。

据悉,模型预训练阶段使用了大量的图像和视频数据,能够理解视觉世界的各种概念,包括物体运动、交互、几何、相机运动和物理规律。为了提高视频生成的质量,模型还进行了监督微调(SFT),使用了一小部分精心挑选的高质量视频和文本标题。报告显示,后训练(Post-training)过程则是 Movie Gen Video 模型训练的重要阶段,能够进一步提高视频生成的质量,尤其是针对图像和视频的个性化和编辑功能。

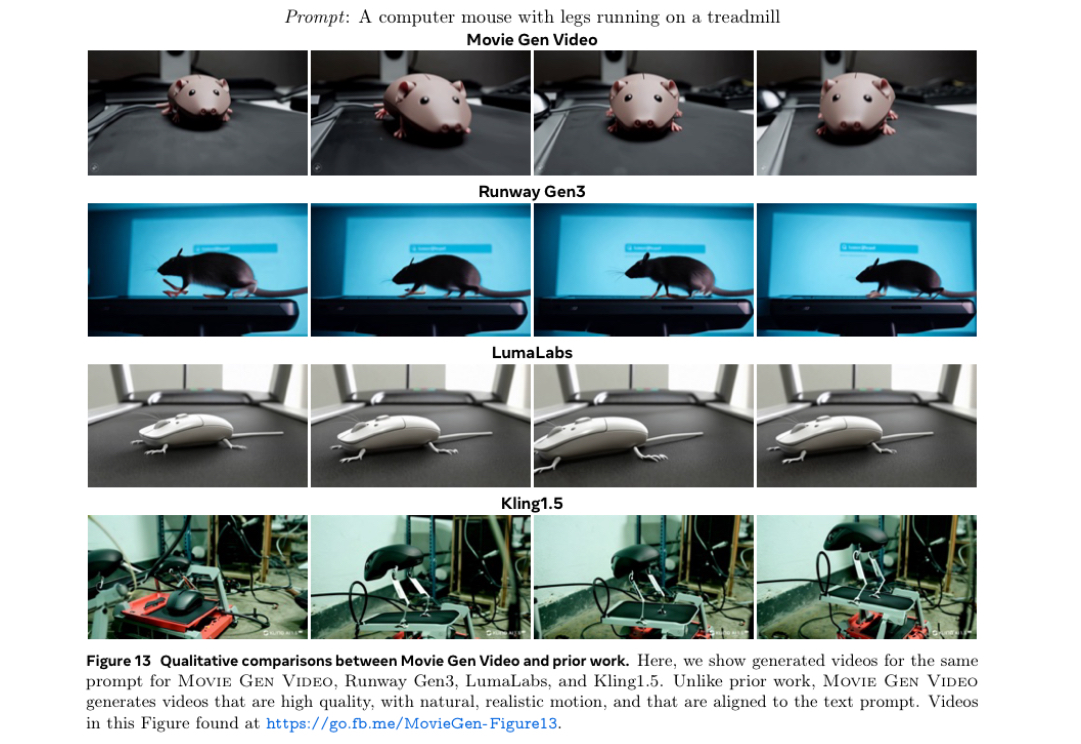

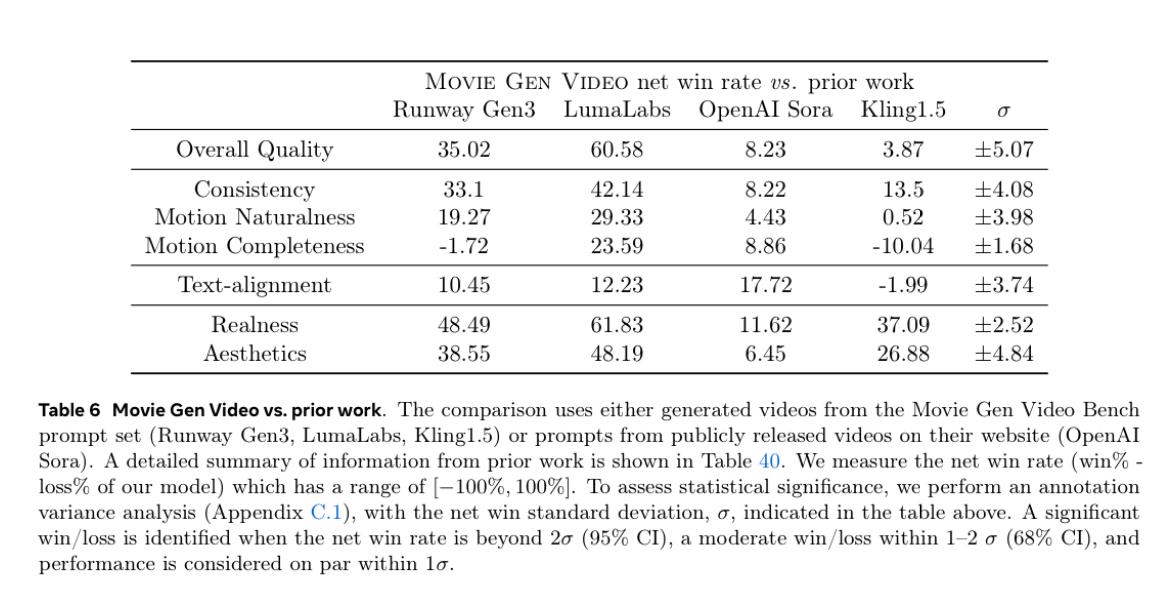

在技术论文中,研究团队公布了 Movie Gen Video 模型与主流视频生成模型的对比数据。由于 Sora 目前尚未开放,研究人员只能使用其公开发布的视频和提示来进行比较。对于其他模型,如 Runway Gen3、LumaLabs 和可灵 1.5,研究人员选择通过 API 接口来自行生成视频。

通过进行胜率比较,Movie Gen Video 在整体质量上显著优于 Runway Gen3和 LumaLabs,对 OpenAI Sora有轻微的优势,与国内的可灵 1.5 相当。

一度在元宇宙领域遭遇困境的Meta,在2024年凭借生成式AI成功逆转命运。在8月初,摩根大通发表报告将Meta目标价由480美元升至610美元,报告指出,Meta近期表现良好,相信已在关键的长远计划上适当投资,尤其是AI。9月底,摩根大通再次宣布看好Meta,将其目标价从610美元上调至640美元。

今年8月,Meta发布的2024年Q2财报显示,公司营收为390.71亿美元,同比增长22%,净利润为134.65亿美元,同比增长73%,均超出华尔街分析师预期。Meta表示,公司在人工智能方面的巨额投资有助于提高其在线广告平台的表现,这是营收增长的一大原因。

目前Meta已连续四个季度收入增幅超过20%。Meta预计,2024年第三季度该公司的总营收将可达到385亿美元至410亿美元之间,这一展望同样超出分析师预期。(刘晓洁)

编辑/田野