随着AI技术的发展,变脸、拟声的深度伪造现象也随处可见。一些人利用这样的先进技术,实施针对老年人的诈骗。有哪些AI新型诈骗方式?如何防范?一起了解。

AI变脸拟声 新型技术针对老年人实施诈骗

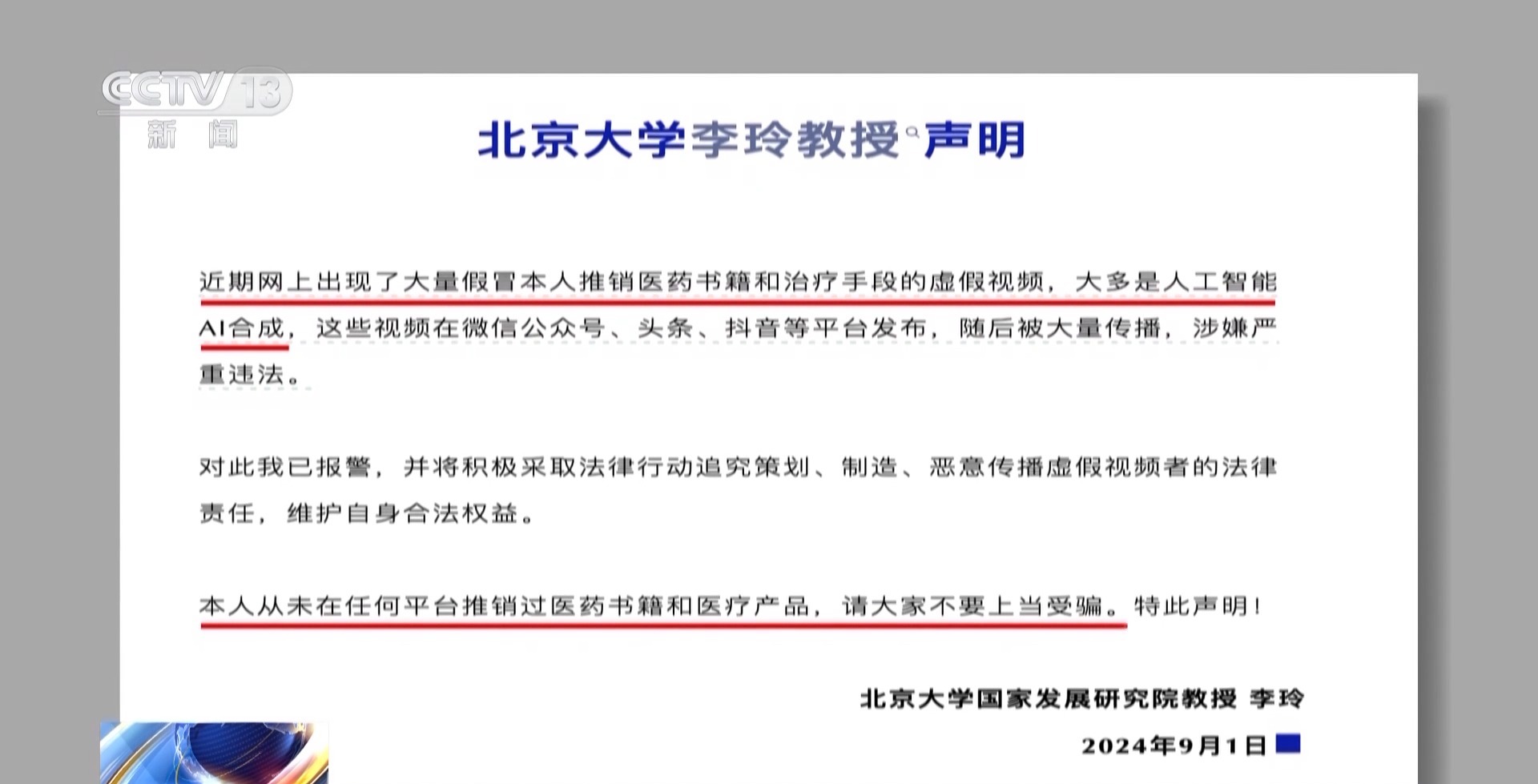

9月1日,北京大学国家发展研究院教授李玲发布了一份公开声明,称“近期网上出现了大量假冒本人推销医药书籍和治疗手段的虚假视频,大多是人工智能AI合成。本人从未在任何平台推销过医药书籍和医疗产品,请大家不要上当受骗”。

随后,李玲教授向警方报警。

北京大学国家发展研究院教授李玲:我觉得这个,不仅损害我的利益,更多的其实是损害了公众的利益。因为老年人更关注健康,会实施一些养生的方法、治疗的方式。所以特别希望我们老年朋友们一定要识别,要看清楚,你买他的东西,他是不是这一行的专家?像我是搞政策的,这个治疗,我不是行家,不会推荐的。

除了卖东西给老年人,更可怕的,还有利用这种深度伪造的技术,实施针对老年人的诈骗。

武汉市公安局汉阳分局琴断口派出所民警接到辖区银行报警,称先后有两位老人,要求提前支取定期存款,疑似遭到了诈骗。而两位老人并不认识,只是碰巧在同一个银行取钱。

武汉市公安局汉阳区分局琴断口派出所民警胡楚文:肖婆婆接到电话,说她上大学的孙子跟别人起了冲突,把对方打伤了,现在正在派出所调解。杨爹爹接到电话,说他的孙子,在路上出了交通事故,需要跟对方私了,因为担心影响后面的工作。

民警向老人解释了AI诈骗的套路,老人都声称,电话里的声音和自己的孙子一模一样。经民警联系家属确认,两位老人的孙子,并没有电话里的情况发生。

武汉市公安局汉阳区分局琴断口派出所民警胡楚文:目前这两个案例,已经非常充分说明,现在的AI技术已经可以模拟声纹、人的面容,所以你所看到的、听到的,都不一定是真的。

还有更极端的事情。一位母亲正和女儿视频聊天,女儿在视频里抱怨“生活费不够用了”,就在这时,家门打开了,她的“真女儿”走了进来。而另一头,视频里的“假女儿”还在央求母亲“给生活费”。

加强治理 帮助老年人防范新型诈骗

在利用新技术进行的新型诈骗中,老年人是弱势群体。他们分辨力低,但平时也离不开手机的使用。如何帮助老年人防范这样的陷阱,也成为大家关心的问题。

在上海和平公园,虹口公安分局民警为现场老年人讲解了当前常见的投资理财诈骗、网络贷款诈骗等电信网络诈骗手段。

在辽宁大连,一场包含AI互动、反诈宣传、知识科普等主题的反诈宣传活动也吸引了不少老年人前来,沉浸式学习预防电信网络诈骗犯罪的相关知识,提升防骗能力。

9月8日开幕的2024年国家网络安全宣传周上,就专门设置了关于AI换脸、换声等对个人隐私侵害的反诈宣传展位。

中国网络空间安全协会人工智能安全治理专业委员会委员张博:除了换脸之外,如果再结合换背景环境、换声音等等,那样逼真度就会更高,更加难以分辨。

近几年,我国对于规范人工智能生成、合成、使用上一直在采取积极措施。

2022年12月,国家网信办等三部门发布《互联网信息服务深度合成管理规定》,旨在加强互联网信息服务深度合成管理。

2023年7月,国家网信办等七部门联合公布《生成式人工智能服务管理暂行办法》,在鼓励创新与发展的同时,进一步完善人工智能管理体系。

2024年7月,国家金融监督管理总局金融消费者权益保护局发布风险提示,提醒公众防范“共享屏幕”“AI换脸拟声”等新型电信网络诈骗。

2024年9月14日,国家网信办发布《人工智能生成合成内容标识办法(征求意见稿)》。

《人工智能生成合成内容标识办法(征求意见稿)》中提出:

人工智能生成合成内容标识包括显式标识和隐式标识。

网络信息服务提供者在提供生成合成内容下载、复制、导出等方式时,应当确保文件中含有满足要求的显式标识。

编辑/朱葳